Projekte Showcase

Crowdsourced Visuals

Eine Installation, die Partizipation und Interaktion innerhalb der Techno-Kultur erforscht.

„Crowdsourced Visuals“ vereint auf einzigartige Weise Design, Technologie, elektronische Musik und gesellschaftliche Fragestellungen in Zeiten der Digitalisierung.

Eine neuromorphe Kamera erfasst während einem DJ-Set anonym die Bewegungen einer tanzenden Techno-Crowd und des DJs und verwandelt diese Eindrücke in dynamische Live-Visuals.

Der besondere Aspekt dabei ist die Wahrung der Anonymität. Durch die Technologie der Kamera werden Bewegungen in die Performance einbezogen, ohne individuelle Identitäten zu enthüllen. Dieser konzeptionelle Ansatz ermöglicht es, das Thema „Identität“ auf abstrakte Weise in den Visuals zu erforschen.

Ziel ist die Schaffung eines interaktiven Erlebnisses, das die Grenzen zwischen Publikum und Künstler verwischt. Es fördert die Partizipation in der elektronischen Musikszene, indem es jeden Besucher zum anonymen Mitgestalter der visuellen Darstellung macht und gleichzeitig tiefgreifende Fragen nach Identität und Gemeinschaft stellt.

- Anna Karolczak (Interaction Design)

- Long Huy Dao (CGI/Motion Design)

- Alexander Sura (CGI/Motion Design)

- Max Fuhrmann (Informatik)

Coaches:

- Fabian Bitter (TH Nürnberg)

- Simon Scharf (HfM Nürnberg)

Lehrende:

- Prof. Dr. Cristian Axenie (Informatik)

- Prof. Moritz Schwind (Design)

Sketchy Sounds

Von Handzeichnungen zu Harmonien: Die Magie von KI-generierten grafischen Partituren.

„Sketchy Sounds“ präsentiert ein KI-Tool, das Musik, Zeichnung und neue Technologie verbindet.

Durch die Umwandlung von Handzeichnungen in musikalische Partituren in Echtzeit, überbrückt es die kreative Kluft zwischen visueller Kunst und Musik.

Menschengruppen haben die Möglichkeit, ihre Zeichnungen in ein musikalisches Format zu verwandeln und so ihre Kreativität in einer neuen, unerwarteten Form auszudrücken.

Die so entstehenden musikalischen Werke gewinnen durch Live-Performances und Projektionen an Leben und schaffen eine Symbiose aus Bild und Ton. Diese Ausstellung bietet nicht nur ein Fenster in die Welt der KI-gesteuerten Musik, sondern lädt auch dazu ein, die eigene künstlerische Ader auf unkonventionelle Weise zu erkunden.

- Laura Maier (Interaction Design)

- Philipp Kremling (Informatik)

- Fiona Zimmermann (Musik)

- Johannes (Informatik)

Coaches:

- Fabian Bitter (TH Nürnberg)

- Simon Scharf (HfM Nürnberg)

Lehrende:

- Prof. Dr. Anna Kruspe (Informatik)

- Max Hässlein (Design)

CoverCraft

Entwicklung von KI-Pipelines zur automatisierten Generierung von Albumcovers.

Projektteam:

- Julian Beekmann (Medieninformatik)

- Paul Kreismann (CGI/Interaction Design)

- Jan (Informatik)

- Max (Informatik)

- zwei weitere Designstudenten

Coaches:

- Fabian Bitter (TH Nürnberg)

Lehrende:

- Prof. Moritz Schwind (Design)

- Prof. Dr. Anna Kruspe (Informatik)

Dieses Projekt erforscht Ansätze für die Gestaltung von Albumcovern, die auf künstlicher Intelligenz basiert.

Durch die automatisierte Analyse von Musikstücken, einschließlich Sentimentanalyse, entfällt das manuelle Prompt Engineering. Die Technologie erfasst die Stimmung und Themen der Musik, um visuell ansprechende und thematisch passende Albumcover zu erstellen.

- Web-App für Smartphones: Eine benutzerfreundliche Anwendung mit ausgewählten Features, optimiert für die schnelle und einfache Erstellung von Albumcovern unterwegs.

- Desktop Web-App: Eine umfangreichere Anwendung für detaillierte Anpassungen und Interaktionen, ideal für Nutzende, die tiefer in den Gestaltungsprozess eintauchen möchten.

Scapemaster

Durch KI-gestützte Tools erweitert das Projekt Scapemaster analoge Pen & Paper-Rollenspiele, bei denen Spieler Charaktere in einer erzählten Welt darstellen und Abenteuer erleben.

Die Tools unterstützen Spielleitende durch einen Mapgenerator für Karten (die auch auf eigenen Skizzen basieren können), einen Moodbildgenerator für die richtige Atmosphäre und einen Musikgenerator für passende, musikalische Untermalung, um das Spielerlebnis immersiv zu gestalten.

Durch die Verknüpfung von traditionellen Rollenspielen mit immersiven Möglichkeiten von Videospielen und der Technologie „generativer KI“ fördert Scapemaster die soziale Interaktion und das persönliche Treffen, indem es die Realität mit digitalen Erlebnissen bereichert.

Projektteam:

- Thuy An Nguyen (Interaction Design)

- Maite Oswald (Interaction Design)

- Artem Sokolov (Interaction Design)

- Britney (Informatik)

- Adrian (Informatik)

- Jan (Informatik)

- Friedrich Lober (Musik)

Coaches:

- Fabian Bitter (TH Nürnberg)

- Simon Scharf (HfM Nürnberg)

Lehrende:

- Max Häßlein (Design)

- Prof. Dr. Korbinian Riedhammer (Informatik)

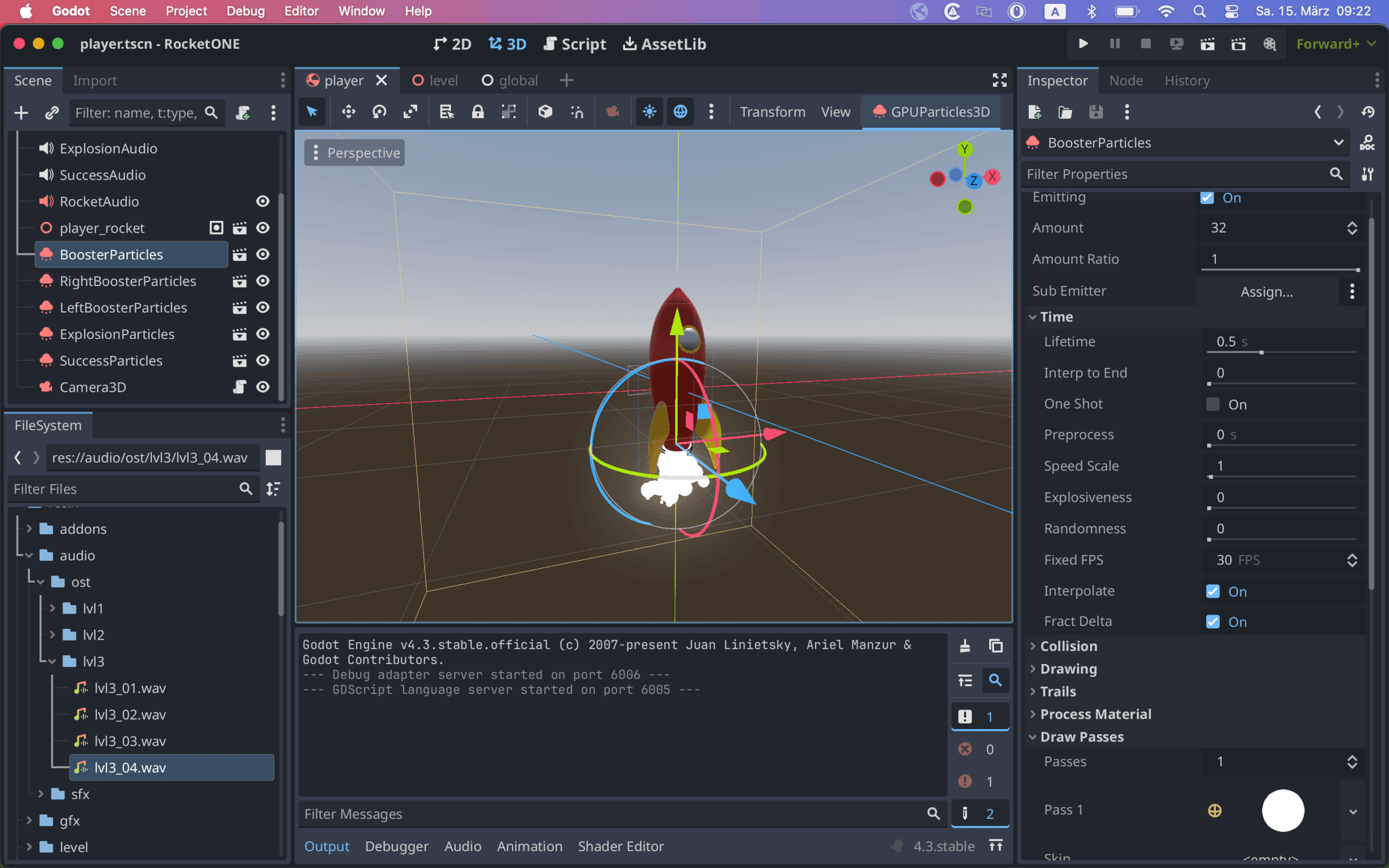

Pizza Planet Pilot

Ein audio-visuelles Spielerlebnis zwischen Navigation und musikalischer Adaptivität.

Pizza Planet Pilot ist ein Videospiel, bei dem du eine kleine Rakete durch drei einzigartige Welten steuerst. Das Besondere daran: Die Musik – vollgepackt mit funkigen Rhythmen und melodischen Klängen – passt sich dynamisch an deine Flughöhe und das Spielgeschehen an. So entsteht ein immersives und musikalisch geprägtes Erlebnis, bei dem Klang und Spielmechanik perfekt ineinanderfließen.

Entwickelt in der Godot-Engine, nutzt Pizza Planet Pilot clever abgestimmte Musik-Loops, die sich nahtlos an deine Aktionen anpassen. Die eher einfach gehaltene Grafik sorgt dafür, dass der Fokus auf der präzisen Steuerung und dem klanglichen Erlebnis liegt.

Das Spiel zeigt, wie Musik nicht nur als Hintergrunddekoration, sondern als zentraler Bestandteil des Game-Designs funktionieren kann. Es beweist, dass interaktive Klangwelten das Spielerlebnis auf ein neues Level heben und völlig neue Wege der Immersion eröffnen. Pizza Planet Pilot lädt dazu ein, über die Rolle von Musik in Games nachzudenken – und gibt dabei noch eine spaßige Herausforderung!

Projektteam:

- Thai Ha (Design)

- Kai List (Design)

- Sophia Rebes (Musik)

Coaches:

- Jan Pfitzer (HfM Nürnberg)

- Fabian Bitter (TH Nürnberg)

Lehrende:

- Max Häßlein (Design)

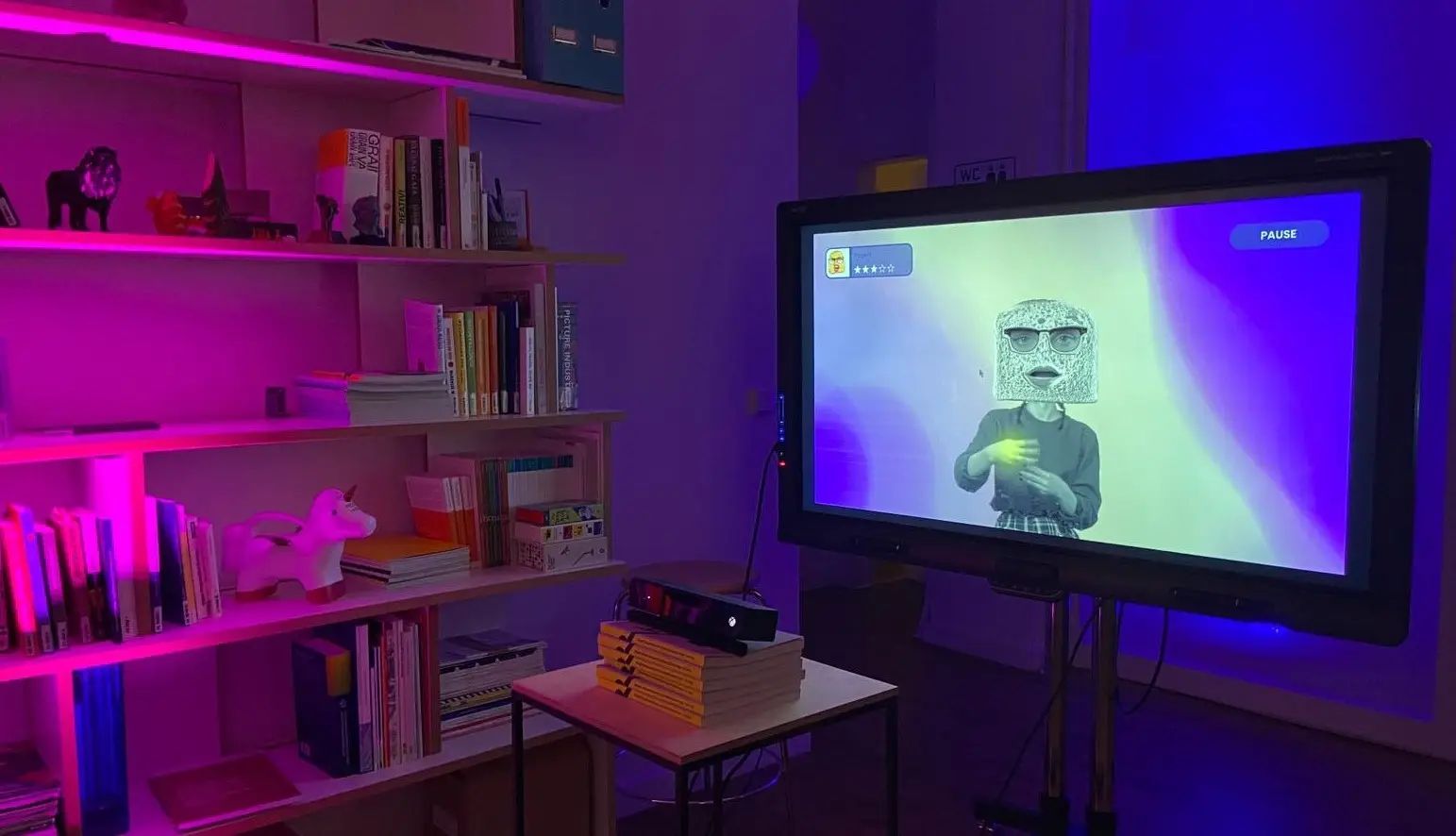

Let's Sign

Hands-On Gebärdensprache: Spielend Kommunikationsgrenzen überwinden

„Let’s Sign“ ist ein interaktives Spiel, das darauf abzielt, das Erlernen der Gebärdensprache zu fördern und so barrierefreie Kommunikation zu unterstützen.

Spielerende versuchen, die Gebärden zu einem Songtext eines Liedes nachzuahmen. Die Leistungsbeurteilung erfolgt durch eine Kamera, die die Bewegungen des Spielers erfasst und mit den vorgegebenen Gebärden vergleicht.

Das Projekt hebt die Bedeutung des Zugangs zur Gebärdensprache als wesentlichen Bestandteil inklusiver Kommunikation hervor und fördert das Bewusstsein und die Fähigkeiten in Gebärdensprache für Hörende.

Projektteam:

- Daria (Interaction Design)

- Isabell Sukkau (Interaction Design)

- Sofia Scheib (Interaction Design)

- Ronja (Informatik)

- Rica (Informatik)

Coaches:

- Fabian Bitter (TH Nürnberg)

Lehrende:

- Max Häßlein (Design)

- Prof. Dr. Cristian Axenie (Informatik)